Автоматика и телемеханика, № 2, 2021

Робастное, адаптивное и сетевое

управление

© 2021 г. О.П. КУЗНЕЦОВ, д-р техн. наук (olkuznes@ipu.ru)

(Институт проблем управления им. В.А. Трапезникова РАН, Москва)

АСИНХРОННЫЕ МНОГОАГЕНТНЫЕ МНОГОСОРТНЫЕ СИСТЕМЫ1

Асинхронная многоагентная многосортная система (АММС) - это сеть

из пороговых элементов (агентов), функционирующая в непрерывном

времени. Агенты находятся либо в активном, либо в пассивном состоя-

нии. В активном состоянии агент генерирует сигнал определенного сорта

(цвета). Сигнал воспринимается всеми агентами, имеющими входы то-

го же цвета. Агент обладает потенциалом, изменяющимся под возбуж-

дающим или тормозящим действием сигналов; он активен, только если

его потенциал превышает порог. Изменения активности агентов являют-

ся событиями, разбивающими временную шкалу на такты - временные

интервалы, внутри которых состояние системы не меняется. Последова-

тельность состояний системы называется ее поведением. Исследуется за-

висимость автономного поведения сети от значений ее параметров.

Ключевые слова: асинхронная система, пороговый элемент, многосортные

сигналы, автономное поведение, события.

DOI: 10.31857/S0005231021020082

1. Введение

Модель, описываемая в данной статье, возникла по двум причинам. Во-

первых, она обобщает модель химических взаимодействий между нейрона-

ми [1]. В предлагаемой модели опущены биологические сущности; в резуль-

тате вместо сети нейронов, обменивающихся химическими сигналами (нейро-

трансмиттерами), появляется сеть из абстрактных агентов, которые обмени-

ваются сигналами разных сортов, циркулирующими в едином пространстве

сигналов и в едином асинхронном времени. Многосортность сигналов озна-

чает, что каждый агент воспринимает только сигналы определенных сортов

и “не слышит” остальные сигналы.

Во-вторых, правомерно рассматривать эту модель как многоагентную си-

стему (МАС), хотя, возможно, это не согласуется с существующей традици-

ей теории МАС. Дело в том, что уже многие годы в этой теории домини-

рует парадигма BDI-архитектуры [2], в которой агенты обладают убежде-

ниями, желаниями и намерениями. Однако, как отмечено в обзоре [3], этот

1 Работа выполнена при частичной финансовой поддержке Российского фонда фунда-

ментальных исследований (проекты №№ 17-29-07029, 20-07-00190).

132

подход не оправдал ожиданий, поскольку потребовал привлечения слож-

ных и вычислительно неэффективных логических средств. В резюме это-

го обзора отмечается, что “в новой парадигме формализации МАС раци-

онально строить как множество простых агентов с богатой компонентой

взаимодействия и широким использованием принципов самоорганизации и

эволюции, присущих живым системам”. Предлагаемая модель удовлетворя-

ет, по крайней мере, требованиям простоты агентов и разнообразию типов

взаимодействия.

Асинхронность - еще одна важная особенность предлагаемой модели.

Асинхронные дискретные модели появились в 50-х гг. ХХ в. в логической схе-

мотехнике [4]. Их главная особенность - зависимость поведения от временных

параметров элементов логических схем. Одной из важных задач проектиро-

вания асинхронных схем всегда являлось преодоление этой зависимости с

целью обеспечения детерминированного поведения схемы [5, 6]. В данной ра-

боте предлагается новый подход к асинхронным сетям, при котором их зави-

симость от временных параметров оказывается достоинством: она порожда-

ет репертуар возможных поведений и позволяет переключать поведение при

изменении параметров. Сеть, в которой зафиксированы все основные пара-

метры ее элементов, будет называться асинхронной системой.

Краткое изложение первых трех разделов настоящей статьи (без доказа-

тельств теорем 2 и 3) опубликовано в [7].

2. Формальная модель - основные определения

Асинхронная многоагентная многосортная система (АММС) S опреде-

ляется как S = < N, C, H, T >, где N = {N1, . . . , Nn} - множество агентов,

C = {c1,...,cm} - множество абстрактных цветов (сортов), H - множество

параметров системы, T - непрерывное время, в котором происходят собы-

тия. Агенты могут находиться в одном из двух состояний - активном и пас-

сивном. Событиями являются моменты изменения состояния любого агента.

Переход агента из пассивного состояния в активное иногда будем называть

включением, а переход из активного состояния в пассивное - выключением.

События разбивают непрерывную шкалу времени на отрезки - такты.

Границы тактов (точки на этой шкале, т.е. моменты наступления событий)

нумеруются натуральными числами и называются дискретными моментами

времени. Такт t - это интервал между моментами t и t + 1, т.е. между дву-

мя соседними событиями. Такты имеют разную длительность; длительность

такта t обозначается τ(t). Текущее состояние активности агента Ni задает-

ся величиной yi(t) ∈ {0, 1}; yi(t) = 1 означает, что на такте t агент активен;

yi(t) = 0 означает, что на такте t агент пассивен.

Выходы, входы и сигналы. В активном состоянии агент Ni генерирует сиг-

нал, характеризуемый цветом cj и мощностью dij . Мощность задается мат-

рицей D = ∥dij ∥n×m, в которой строки соответствуют агентам, а столбцы -

цветам. Агент Ni обладает входами, каждый из которых имеет цвет из мно-

жества C. Разные входы имеют разные цвета; вход цвета cj имеет вес wij ∈ R.

Вес wij = 0 означает, что у агента Ni нет входов цвета cj ; wij > 0 означает,

что сигнал, пришедший на вход цвета cj, оказывает на агента возбуждаю-

133

щее воздействие, wij < 0 означает тормозное воздействие. Множество весов

также удобно задавать матрицей W = ∥wij ∥n×m.

По характеру активности агенты делятся на два типа: инициативный и

реактивный. Инициативный агент переходит в пассивное состояние только

при достаточно сильных тормозящих воздействиях; в остальное время он

активен. Реактивный агент активизируется только при достаточно сильных

возбуждающих воздействиях; в остальное время он пассивен.

Совокупность цветов, присвоенных входам и выходу агента Ni, а также

знаки весов его входов будем называть разметкой агента. Разметки агентов

однозначно определяют связи между агентами: ориентированная связь от

агента Nk к агенту Nl существует, если Nl имеет вход, цвет которого совпа-

дает с цветом выхода Nk. Будем считать, что эта связь имеет тот же цвет.

Тем самым разметка всех агентов однозначно порождает раскрашенный ори-

ентированный граф системы S, который будем называть размеченной сетью

(или просто сетью) ΣS системы S.

Из приведенных определений следует, что сигнал цвета cj будет воспринят

только теми агентами, которые имеют входы цвета cj . Иначе говоря, сигналы

в системе являются, с одной стороны, широковещательными, а с другой - из-

бирательными. Заметим также, что в АММС возможны “скрытые” входы и

выходы: это соответствует случаям, когда некоторый цвет имеют только вхо-

ды или только выходы. В автономной (не имеющей внешних входов) системе

такой цвет не будет влиять на ее функционирование.

Внешним (наблюдаемым) состоянием системы в момент t называется век-

тор состояний активности всех агентов системы, т.е. вектор Y (t) = (y1(t),

...,yn(t)).

Пространство сигналов описывается вектором X(t) = (x1(t), . . . , xm(t)),

где xj (t) - суммарная мощность сигналов цвета cj, генерируемых на протя-

жении такта t и распространяемых по связям этого цвета. Она вычисляется

по формуле

∑

(1)

xj(t) =

dijyi

(t) .

i=1

В матричном виде эта формула принимает вид

(1а)

X(t) = Y (t) × D,

где X(t) - вектор-строка пространства сигналов, Y(t) - вектор-строка актив-

ности нейронов.

Потенциалы агентов. Агент Ni имеет потенциал Ui(t) - непрерывную ве-

личину, которая может изменяться в интервале Ui0 ≤ Ui(t) ≤ Uimax. Агент

активен, если величина Ui(t) не меньше порогового значения Pi, которое так-

же находится в интервале Ui0 < Pi < Uimax:

{

1, если Ui(t) ≥ Pi;

(2)

yi(t) =

0

иначе.

134

Значения Ui0, Uimax и Pi специфичны для каждого агента.

Потенциал агента Ni внутри такта меняется, но не создает событий; важны

только его значения Ui(t) и Ui(t + 1). Внутри такта потенциал изменяется

линейно, т.е. с постоянной в пределах такта суммарной скоростью vi(t):

(3)

vi (t) = si (t) + vαien

(t),

где si(t) - экзогенная скорость, пропорциональная силе внешних воздействий:

∑

(4)

si (t) = h

wijxj

(t),

j=1

vαien - эндогенная скорость, т.е. собственная скорость агента, не зависящая от

внешних воздействий; в дальнейшем полагаем h = 1. Перепишем (4) в мат-

ричном виде:

(4а)

S(t) = X(t) × WT,

где S(t) - вектор-строка экзогенных скоростей (сил внешних воздействий),

X(t) - вектор-строка пространства сигналов, WT - транспонированная мат-

рица весов.

Каждый агент имеет два значения эндогенной скорости:

{ v0ien, если Ui (t) < Pi,

(5)

vαien(t) =

v1ien, если Ui (t) ≥ Pi,

причем для инициативного агента обе скорости положительны, для реактив-

ного агента обе скорости отрицательны и для обоих типов агентов v0ien < v1ien.

Параметры системы. Параметры, определяющие систему S (формулы

(1)-(5)), разбиваются на два класса: статические (не меняющиеся в процес-

се функционирования) и динамические параметры. Статические параметры

(количество входов, их веса, величина порога и др.) образуют множество H,

описываемое табл. 1. Динамические параметры (yi(t), Ui(t), vi(t) и др.) меня-

ются со временем.

Будем считать, что асинхронная система S = < N, C, H, T > состоит из

двух компонентов: размеченной сети ΣS и ее параметров. Cеть ΣS системы S

определяется множествами N, C и разметками агентов; множество парамет-

ров H задается табл. 1.

Таблица 1. Статические параметры системы

Pi Umaxi U0i v0ien v1ien di1 ... d1m wi1 ... wim

N1

P1

Umax1

U01

v01en v11en d11 ... d1m w11 ... w1m

Ni

U0i

Nn Pn Umaxn U0n v0nen v1nen dn1 ... dnm wn1 ... wnm

135

Такое разделение позволяет говорить об изменениях параметров без из-

менения сети. Две АММС, имеющие одну и ту же сеть Σ, но отличающиеся

наборами значений параметров Hk и Hl, будем называть конфигурациями

сети Σ и обозначать как Σ(Hk) и Σ(Hl).

3. Динамика системы и ее вычисление

3.1. Динамические параметры системы

Последовательность состояний Y (0), Y (1),. . . , порождаемую системой, бу-

дем называть поведением системы. В дальнейшем рассматривается автоном-

ное поведение системы, т.е. поведение при отсутствии внешних воздействий.

Алгоритм, вычисляющий ее поведение, должен по заданному состоянию си-

стемы в момент t вычислить ее состояние в момент t + 1. Однако в асинхрон-

ной системе вычислению состояния в момент t + 1 предшествует вычисле-

ние самого момента t + 1, т.е. длительности τ(t) такта [t, t + 1) и положения

момента t + 1 на шкале непрерывного времени. Это вычисление связано с

пересчетом на каждом такте динамических параметров системы.

К уже введенным ранее динамическим параметрам yi(t), xj(t), Ui(t), si(t),

vi(t) добавим несколько новых динамических параметров.

Остаточным потенциалом ΔUi(t) в момент t назовем величину, равную

“расстоянию” до наступления ближайшего события, связанного с агентом Ni.

Ближайшее событие для агента Ni определяется таблицей переходов, одина-

ковой для обоих типов агентов; ее вид приведен в табл. 2. Знак ∞ означает,

что значение потенциала агента Ni в такте t не достигнет порога и ближай-

шее событие не связано с агентом Ni. Если vi(t) = 0, то ΔUi(t) = ΔUi(t - 1),

поэтому этого случая в таблице нет.

Таблица 2. Таблица переходов для агентов

Ui(t)

Знак vi(t)

Ближайшее событие

ΔUi(t)

1

Ui(t) ≥ Pi

+

Движение вверх, активность не меняется,

∞

события нет

2

Ui(t) ≥ Pi

-

yi = 0

Ui(t) - Pi

3

Ui(t) < Pi

+

yi = 1

Pi - Ui(t)

4

Ui(t) < Pi

-

Движение вниз, активность не меняется,

∞

события нет

Остаточное время τri(t) агента Ni - это время до достижения ближайшего

события при текущем потенциале Ui(t) и скорости vi(t). Знак ∞ означает,

что это время не влияет на вычисление следующего события.

Ui(t)

,

если vi = 0 и ΔUi (t) = ∞,

(6)

τri(t) =

⌈vi(t)⌉

∞ в остальных случаях.

136

3.2. Алгоритм функционирования автономной АММС

и его вычислительная сложность

Теорема 1. Поведение автономной АММС однозначно определяется

вектором U(0) = (U1(0), . . . , Un(0)) и множеством ее статических пара-

метров H.

Доказательством служит алгоритм, который по заданным U(t) и H вы-

числяет Y (t) и U(t + 1) для любого t.

Этот алгоритм выглядит так:

1. Вектор Y (t) вычисляется по формуле (2).

2. Вектор X(t) вычисляется по формуле (1а).

3. Силы воздействия s1(t), . . . , sn(t) вычисляются по формуле (4а).

4. Суммарные скорости v1(t), . . . , vn(t) вычисляются по формулам (3), (5).

5. Остаточные потенциалы вычисляются по табл. 2.

6. Остаточные времена вычисляются по формуле (6).

7. Ищется минимальное остаточное время τmin(t). Если τmin(t) = τi(t), то:

- длина такта t τ(t) = τi(t);

- событием является изменение активности агента Ni;

- состояние Y (t + 1) отличается от Y (t) значением yi(t + 1).

8. Потенциалы для момента t + 1 пересчитываются по формуле

Uimax, если Ui(t) + τ(t)vi(t) ≥ Uimax,

(7)

Ui(t + 1) =

Ui0,

если Ui(t) + τ(t)vi(t) ≤ Ui0,

Ui (t) + τ (t) vi (t) в остальных случаях.

9. Перейти к п. 1 для t + 1.

Оценим вычислительную сложность шага этого алгоритма, воспользовав-

шись матричным представлением формул (1a) и (4a). Известно, что слож-

ность произведения матриц A∥l×k∥ × B∥k×p∥ имеет порядок O(lkp). В форму-

ле (1а) имеем l = 1, k = n, p = m. Поэтому сложность вычисления (1а) рав-

на O(mn). Аналогично получаем, что сложность вычисления формулы (4а)

также равна O(mn). Остальные шаги имеют сложность, не превосходящую

O(n). Поэтому сложность вычисления одного такта имеет порядок O(mn).

Важно отметить, что эта сложность линейна относительно числа агентов n,

поскольку естественно считать, что число сортов сигналов m растет гораздо

медленнее, чем число агентов.

Теорема 1 дает основание называть вектор U(t) внутренним состоянием

АММС.

3.3. Примеры

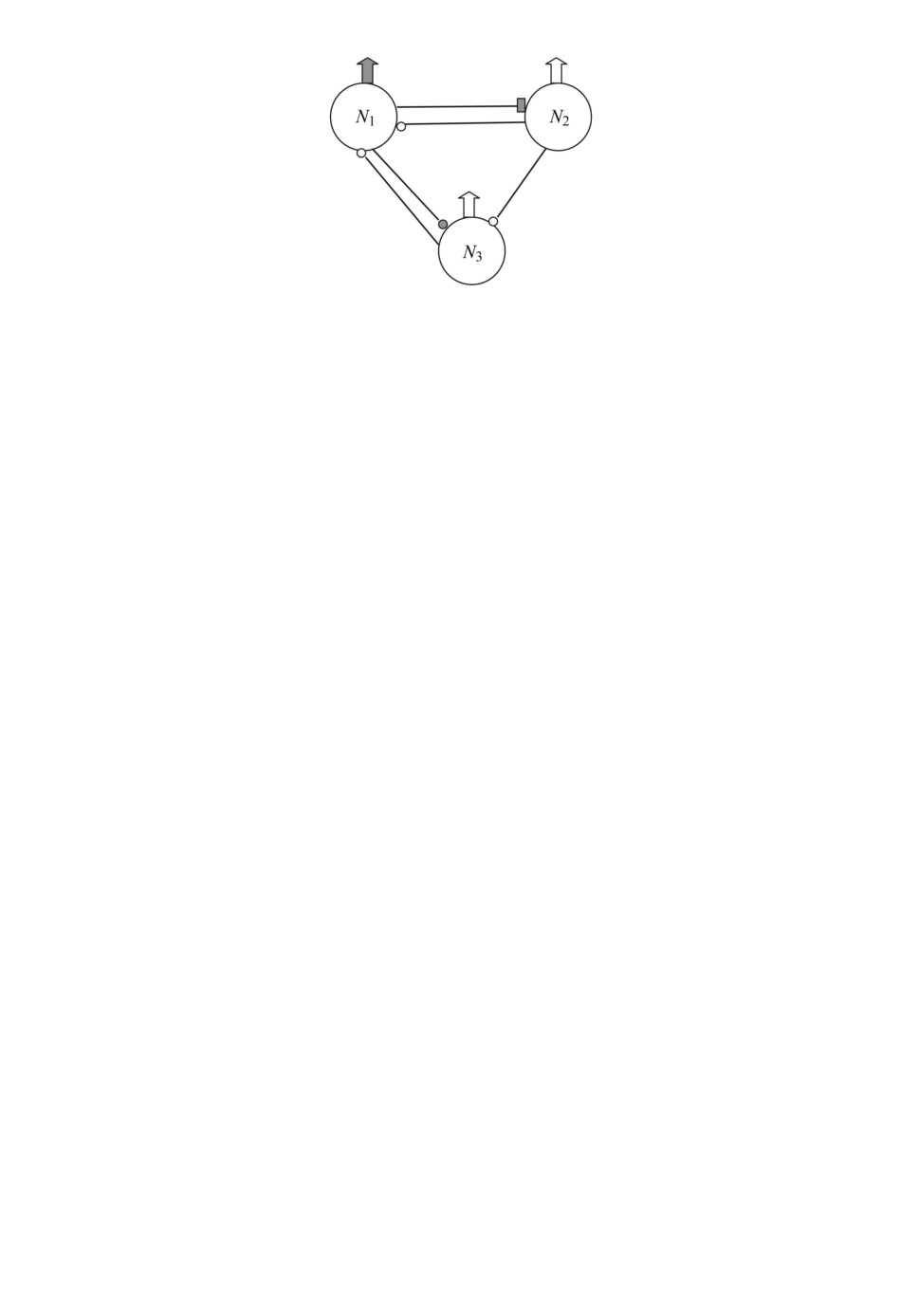

Пример 1. На рисунке показана размеченная сеть Σ1, где N1 и N3 -

инициативные агенты, N2 - реактивный агент. Приведем расчет динамиче-

ских параметров для конфигурации Σ1(H1) и начального состояния U(0) =

= (0,9; 0; 0,9). Набор статических параметров H1 задан табл. 3.

137

Сеть примера 1.

Момент t = 0:

Начальное состояние (текущие потенциалы): U(0) = (0,9; 0; 0,9).

1. Начальное внешнее состояние Y (0) = (1; 0,1).

2. X(0) = (0,5; 0,3).

3. Силы воздействия:

s1(0) = w12x2(0) = -0,3;

s2(0) = w21x1(0) = 1;

s3(0) = w31x1(0) + w32x2(0) = -0,15 - 0,3 = -0,45.

4. Суммарные скорости:

v1(0) = s1(0) + v11en = -0,3 + 0,8 = 0,5,

v2(0) = s2(0) + v02en = 1 - 0,8 = 0,2,

v3(0) = s3(0) + v13en = -0,45 + 0,8 = 0,35.

5. Остаточные потенциалы:

ΔU1(0) = ∞ (строка 1 табл. 2),

ΔU2(0) = P2 - U2(0) = 0,6,

ΔU3(0) = ∞ (строка 1 табл. 2).

6. Остаточные времена:

τr1(0) = ∞;

τr2(0) = ΔU2(0)/ | v2(0) |= 0,6/0,2 = 3;

τr3(0) = ∞.

7. Минимальное остаточное время τmin(0) = τ2(0) = 3.

Соответственно, длина такта [0, 1] будет τ(0) = 3.

Событие, произошедшее в момент 1, - включение нейрона N2.

8. Потенциалы для момента t = 1:

U (1) = (0,9; 0,6; 0,9).

Таким образом, к моменту t = 1 получаем внешнее состояние Y (1) =

= (1, 1, 1), внутреннее состояние U(1) = (0,9; 0,6; 0,9) и начальный отрезок по-

ведения 101, 111. Это дает возможность начать расчет для момента t = 1.

138

Таблица 3

Pi

Uimax

Ui0

v0ien

v1ien

di1

di2

wi1

wi2

N1

0,6

0,9

0

0,5

0,8

0,5

-

0

-1

N2

0,6

0,9

0

-0,8

-0,5

-

1,0

2

0

N3

0,6

0,9

0

0,5

0,8

-

0,3

-0,5

-1

Таблица 4

№t

0

1

2

3

4

5

6

7

8

9

10

Y (t)

101

111

110

010

000

100

101

111

U1(t)

0,9

0,9

0,7

0,6

0,3

0,6

0,9

0,9

U2(t)

0

0,6

0,8

0,9

0,6

0,12

0,36

0,6

U3(t)

0,9

0,9

0,6

0,225

0

0,3

0,6

0,9

x1

0,5

0,5

0,5

0

0

0,5

0,5

0,5

x2

0,3

1,3

1

1

0

0

0,3

1,3

τ (t)

3

0,4

0,5

0,6

0,6

1,2

1,2

0,4

v1

0,5

-0,5

-0,2

-0,5

0,5

0,8

0,5

-0,5

v2

0,2

0,5

0,5

-0,5

-0,8

0,2

0,2

0,5

v3

0,25

-0,75

-0,75

-0,5

0,5

0,25

0,25

-0,75

Полный протокол вычисления поведения (вместе с изменениями динами-

ческих параметров) конфигурации Σ1(H1) приведен в табл. 4.

Видно, что внутренние состояния в тактах 1 и 7 повторяются. Из теоремы 1

следует, что в дальнейшем отрезок протокола, образованный столбцами 1-6,

будет повторяться в дальнейшем.

Пример 2. Рассмотрим теперь поведение конфигурации Σ1(H2), в кото-

рой набор параметров H2 получен из H1 заменой значения d11 = 0,5 на d11 =

= 0,3. Для этого достаточно изменить некоторые величины в приведенном

выше расчете. Получим: X(0) = (0,3; 0,3); s2(0) = w21 · x1(0) = 0,6; отсюда

v2(0) = s2(0) + v02en = 0,6 - 0,8 = -0,2, т.е. суммарная скорость роста потен-

циала N2 становится отрицательной и потенциал N2 не растет. Формально

это означает, что для ΔU2(0) выполняются условия строки 4 таблицы 2, т.е.

ΔU2(0) = ∞. В результате все остаточные потенциалы получают значение ∞,

а это означает, что процесс остановился в самом начале, и поведение конфи-

гурации Σ1(H2) состоит из одного начального внешнего состояния 101.

Эти два примера показывают, что одна и та же сеть при разных парамет-

рах может генерировать различное поведение. Множество всех ее возможных

поведений будем называть репертуаром поведений сети. Ниже будут рассмот-

рены некоторые задачи анализа репертуара поведений автономной сети.

4. Анализ репертуара поведений автономной пороговой сети

Напомним ряд известных понятий. Бесконечная последовательность

a0,a1,... ,ak-1,ak,... ,al-1,... называется периодической, если некоторый ее

отрезок ak, . . . , al-1 повторяется бесконечное число раз. Этот отрезок назы-

вается периодом, а отрезок a0, a1, . . . , ak-1 - предпериодом. Такая последо-

139

вательность записывается как a0, a1, . . . , ak-1, (ak, . . . , al-1). Длиной предпе-

риода является целое число k ≥ 0, а длиной периода - целое число l - k ≥ 1.

В поведении АММС два вектора Y (t), Y (t + 1) всегда отличаются хотя

бы в одном разряде, потому что в момент t + 1 изменилось состояние, по

крайней мере, одного агента. Поэтому для АММС случай l - k = 1 соответ-

ствует тому, что начиная с момента k, событий не происходит: потенциалы

всех агентов соответствуют строкам 1 или 4 табл. 2 и последовательность

Y (0), . . . , Y (k - 1), Y (k) становится конечной. Такое поведение будем назы-

вать стационарным; его заключительное состояние Y (k) также стационарно.

Поведение конфигурации Σ1(H2) (пример 2) - это пример стационарного по-

ведения длины 1; его начальное состояние является одновременно заключи-

тельным и, следовательно, стационарным.

При l - k > 1 бесконечное поведение Y (0), . . . , Y (k - 1), (Y (k), . . . , Y (l - 1))

будем называть периодическим поведением. Поведение конфигурации Σ1(H1)

(пример 1) - это пример периодического поведения, в котором длина периода

равна 6, а длина предпериода равна 1.

Теорема 1 показывает, что автономную АММС можно интерпретировать

как автономный автомат, в котором состояниями являются векторы U(t). Из

теории конечных автоматов [8] известно, что автономный конечный автомат

генерирует периодическую последовательность состояний, причем длина как

периода, так и предпериода не превосходит число M состояний. Это объясня-

ется тем, что благодаря конечности числа состояний не позднее, чем через M

тактов, появится состояние Y (t), t ≤ M, которое совпадет с одним из преды-

дущих состояний Y (t′), t′ < t и возникнет периодическая последовательность

c периодом (Y (t′), . . . , Y (t-1)), длина которого меньше M. Однако в автоном-

ной АММС это рассуждение не проходит, поскольку множество возможных

значений потенциалов бесконечно, и вопрос о том, всегда ли автономная АС

генерирует периодическую последовательность состояний, остается откры-

тым. Здесь ограничимся некоторыми простыми утверждениями.

Начальное состояние сети U (0) будем называть естественным, если для

любого инициативного агента Ni выполняется Ui(0) > Pi, а для любого реак-

тивного агента Nj выполняется Uj (0) < Pj .

Теорема 2. Для любой автономной асинхронной сети Σ и любого ее

естественного состояния U(0) существует такой набор параметров H,

при котором в конфигурации Σ(H)U(0) является стационарным.

Доказательство. Пусть U(0) - естественное начальное состояние. Из

табл. 2 видно, что оно будет стационарным, если суммарные скорости для

всех инициативных агентов положительны, а для всех реактивных агентов

отрицательны. Поэтому из (3), (4) получаем, что искомый набор параметров

должен удовлетворять следующим условиям:

∑

wijxj (0) + v1ien > 0, если Ni - инициативный агент;

j=1

(8)

∑

wijxj (0) + v0ien < 0, если Ni - реактивный агент.

j=1

140

Конкретный набор значений, удовлетворяющий условиям (8), можно по-

лучить следующим образом. Назначаем произвольные значения параметров

∑m

wij и dij; при этом для всех агентов сформируются суммы

wijxj (t).

j=1

Найдем среди них максимальную и минимальную суммы. Затем назначаем

эндогенные скорости vαien(t), удовлетворяющие (8):

1) для инициативных агентов:

∑

если max

wijxj (t) > 0, то v1ien - любое положительное число;

i

j=1

∑

∑

если max

wijxj (t) ≤ 0, то v1ien >

max

wijxj (t);

i

i

j=1

j=1

2) для реактивных агентов:

∑

если min

wijxj (t) < 0, то v0ien - любое отрицательное число;

i

j=1

∑

∑

если min

wijxj (t) ≥ 0, то v0ien < -min

wijxj (t).

i

i

j=1

j=1

Теорема доказана.

Если U (0) не является естественным, теорема может стать неверной: ко-

гда инициативный агент пассивен и входное торможение мало, его суммарная

скорость положительна и через некоторое время он станет активным. Ана-

логично, если реактивный агент активен и входное возбуждение мало, то его

суммарная скорость отрицательна и через некоторое время он станет пассив-

ным.

Теорема 3. Существуют сети, все поведения которых стационарны.

Покажем, что такими сетями являются все ациклические сети. Пусть Σ -

ациклическая сеть. Тогда 1) у нее есть агенты-источники, у которых нет вход-

ных связей, и агенты-стоки, у которых нет выходных связей; 2) для любого

агента Ni остальные агенты делятся на три группы: а) предки Ni - агенты,

из которых есть пути к Ni; б) потомки Ni - агенты, к которым есть пути

из Ni; в) остальные агенты.

Ацикличность сети позволяет провести ранжирование всех агентов по са-

мому длинному пути из источника: агент Ni получает ранг j, если самый

длинный путь из источников в Ni имеет длину j. Заметим, что при такой

ранжировке а) агент ранга j обязательно имеет входящее ребро от некото-

рого агента ранга j - 1; б) все предки агента ранга j имеют строго меньшие

ранги; в) между агентами одного ранга связей нет.

Рассмотрим множество агентов-источников, т.е. агентов ранга 0. Так как

они не имеют воздействий от других агентов сети, то наступит момент t0, ко-

гда все они перейдут в стационарное естественное состояние: инициативные

агенты станут стационарно активными, а реактивные агенты - стационарно

пассивными. С этого момента все сигналы, идущие к агентам ранга 1, стано-

вятся стационарными и, следовательно, суммарные скорости агентов ранга 1

141

перестанут изменяться. Поэтому наступит момент t1, когда все агенты ран-

га 1 перейдут в стационарное состояние. Рассуждая индуктивно, допустим,

что существует момент tj, в котором все агенты ранга j перешли в стационар-

ное состояние. С этого момента все сигналы, идущие к агентам ранга j + 1,

становятся стационарными и, следовательно, суммарные скорости агентов

ранга j + 1 перестанут изменяться. Поэтому наступит момент tj+1, когда все

агенты ранга j + 1 перейдут в стационарное состояние. Отсюда следует, что

наступит момент tmax, когда агенты с максимальным рангом перейдут в ста-

ционарное состояние, что и доказывает теорему.

5. Анализ устойчивости поведения автономной сети

к изменениям ее параметров

5.1. Постановка задачи и пример

Важным аспектом исследования репертуара поведений асинхронной сети

является вопрос об устойчивости конкретного поведения сети к изменениям

параметров ее элементов. Точная постановка задачи такова. Задана сеть Σ,

конкретная конфигурация Σ(H) и ее начальное состояние. Каковы области

изменения параметров сети, при которых это поведение не изменяется?

Здесь ограничимся случаем, когда изменяется один параметр. Для этого

случая точная постановка задачи выглядит так. Будем рассматривать по-

ведение сети Σ на множестве конфигураций Σ(Hp) таких, что в любых двух

конфигурациях Σ(Hpi) и Σ(Hpj) из этого множества наборы Hpi и Hpj отлича-

ются только значениями параметра p. Задача заключается в том, чтобы для

любого начального состояния Y (0) найти множество положительных чисел

h1,h2,..., разбивающих полуось значений параметра p на такие интерва-

лы [0, h1), [h1, h2), . . . , [hk-1, hk), . . . , что поведения конфигураций Σ(Hpi) и

Σ(Hpj) одинаковы, если pi и pj находятся внутри одного интервала, и различ-

ны, если pi и pj находятся в разных интервалах. Такие интервалы назовем

интервалами устойчивости поведения сети относительно параметра p.

Пример 3. Сначала в качестве примера проведем поиск начального ин-

тервала устойчивости [0, h1) поведения сети на рисунке относительно пара-

метра d11. Как и в предыдущих примерах, начальным внутренним состоянием

является U(0) = (0,9; 0; 0,9).

Как видно из примера 2, при d11 = 0,3 поведение является стационарным.

Заметим, что при этом все три агента находятся в естественных состояниях.

Область устойчивости этого поведения, как следует из табл. 2 (строка 1 для

N1 и N3, строка 4 для N2), определяется следующими неравенствами:

(9)

v1(0) ≥ 0, v2(0) ≤ 0, v3

(0) ≥ 0.

Раскрывая суммарные скорости, получим:

s1(0) + v11en ≥ 0, т.е. s1(0) ≥ -0,8,

(10)

s2(0) + v02en < 0, т.е. s2(0) < 0,8,

s3(0) + v13en ≥ 0, т.е. s3(0) ≥ -0,8.

142

Подставим вместо si(0) их выражения из шага 3 алгоритма:

(11)

w12x2(0) ≥ -0,8, или w12d32

≥ -0,8,

(12)

0,8 ≥ w21x1(0), или

0,8 ≥ w21d11,

(13)

w31x1(0) + w32x2(0) ≥ -0,8, или w31d11 + w32d32

≥ -0,8.

Если в эти формулы подставить значения весов wij из табл. 4, то получим:

(14)

-d32 ≥ -0,8 т.е. d32

≤ 0,8,

(15)

0,8 ≥ 2d11, т.е. d11

≤ 0,4,

(16)

−0,5d11 - d32 ≥ -0,8, т.е. 0,5d11 + d32

≤ 0,8,

причем неравенство (16) слабее, чем (15), и является лишним.

Видно, что при значениях d11 ≤ 0,4 поведение сети не изменится, посколь-

ку суммарная скорость v2(0) останется отрицательной. Поэтому 1) стацио-

нарное поведение сети рисунке, описанное в примере 2, остается неизмен-

ным, если d11 находится в интервале (0, 0,4], а остальные параметры сети не

меняются; 2) при d11 > 0,4 поведение сети должно измениться.

Для поиска верхней границы этого поведения воспользуемся описываемым

ниже методом.

Пусть для заданного начального состояния Y (0) вычислены границы по-

луинтервала [hk-1, hk) устойчивости относительно p. Будем искать верхнюю

границу интервала [hk, hk+1), а также вычислять поведение сети в этом ин-

тервале.

5.2. Метод определения границ областей устойчивости

для одного параметра p

Идея метода заключается в том, чтобы провести вычисления алгоритма

п. 3.2 со значением параметра p = hk + ε, где ε - неизвестное положительное

число. В ходе этих вычислений будут возникать выражения, содержащие ε.

Формируя неравенства из этих выражений (подобно тому, как это делалось

выше при получении неравенств (9)-(16)), будем их решать относительно ε и

среди решений вида ε < q, где q > 0, выбирать решение с наименьшим q. Ре-

шения вида ε > q выбираться не будут, поскольку они не относятся к окрест-

ности hk. Если поведение периодично или стационарно, получим конечное

число решений вида ε < q. Тогда hk+1 - это наименьшее из всех полученных

значений q.

Шаги базового алгоритма п. 3.2, которые будут использоваться в описании

метода, будем обозначать как А1, А2, . . . , а шаги самого метода - как М1,

М2,

Обозначим набор параметров, в котором p = hk, через Hpk, а набор, в

котором p = hk + ε, через Hpkε. Метод определим индуктивно: считаем, что

для первых t - 1 тактов уже вычислено поведение конфигурации Σ(Hpkε) и

найдена минимальная оценка ε < q(t - 1). Опишем шаги метода для текущего

такта t.

143

М1. Вычисляются первые 4 шага алгоритма п. 3.2 для начального сос-

тояния Y (t) и конфигурации Σ(Hpkε). При этом выражения для некоторых

вычисляемых параметров будут содержать не только числа, но и символ ε.

М2. Для всех i = 1, . . . , n проверяются условия переключения агента Ni:

(17)

если yi = 0, то vi

> 0,

(18)

если yi = 1, то vi

< 0.

Для любого агента Ni, у которого ни одно из неравенств (17), (18) не

выполняется, ΔUi(t) = ∞. Эти агенты в дальнейших вычислениях не участ-

вуют. Если ΔUi(t) = ∞ для всех i, то процесс вычисления останавливается;

состояние Y (t) стационарно.

М3. Для остальных агентов возникнут неравенства, некоторые из которых

содержат ε. После решения этих неравенств из решений вида ε < q, q > 0,

выбирается решение q0(t), минимальное среди всех q. Текущей оценкой для ε

полагается q1(t) = min(q0(t), q(t - 1)).

М4. Вычисляются шаги А5 и А6. На шаге А6 получаются равенства вида

τri(t) = αri, где αri - либо положительные числа, либо выражения, содержа-

щие ε.

М5. - Если все остаточные времена равны ∞, то процесс вычисления оста-

навливается; состояние Y (t) стационарно; hk+1 = q1(t);

- если только для одного i τri(t) = ∞, то в такте t переключается агент Ni

и состояние Y (t + 1) отличается от Y (t) состоянием агента Ni; длина такта

τ (t) = τri(t); q(t) = q1(t);

- в противном случае формируется множество A = {α∗r}, в которое вклю-

чаются все αri, содержащие ε, а также наименьшее из αri, являющихся чис-

лами.

М6. Для каждой пары (α∗ri, α∗rj ) формируются два неравенства α∗ri < α∗rj,

α∗ri > α∗rj и решаются относительно ε. Верными считаются неравенство, ко-

торое дает решение вида ε < q, и соответствующее неравенство τri < τrj или

τri > τrj.

М7. Из верных неравенств, полученных на предыдущем шаге, находим

τmin(t) и выполняем шаг А7, т.е. определяем следующее состояние и длину

такта.

М8. Среди правых частей неравенств вида ε < q, полученных на ша-

ге М6, находится минимальное q. Обозначим его как q2(t). Полагаем

q(t) = min(q2(t), q(t - 1)). Таким образом, поведение сети на первых t + 1 ша-

гах сохраняется в интервале hk < p < hk + q(t).

М9. Выполняется шаг А8 базового алгоритма - пересчет потенциалов.

В выражениях, полученных на этом шаге, по-прежнему возможно появле-

ние ε.

М10. Перейти к М1 для t + 1.

Пример 4. Приведем пример, поясняющий шаги М4-М7.

Пусть для сети из 3 агентов на шаге М4 получены равенства τr1 = 2ε,

τr2 = 0,5 - 0,3ε, τr3 = 0,4.

144

Множество А (шаг М5) состоит из правых частей этих равенств.

М6. Для каждой пары из А составляем два неравенства:

для αr1, αr2: 2ε < 0,5 - 0,3ε, откуда ε < 5/23 ≈ 0,21; противоположное

неравенство неверно; поэтому τr1 < τr2;

для αr1, αr3: 2ε < 0,4 и ε < 0,2; поэтому τr1 < τr3;

для αr2, αr3: 0,4 < 0,5 - 0,3ε и ε < 1/3; поэтому τr3 < τr2.

М7. Из полученных неравенств заключаем, что τmin(t) = τr1.

М8. q(t) = 0,2, т.е. ε < 0,2.

Пример 5. В примере 3 было показано, что верхняя граница для интер-

вала [0, h1) поведения сети на рисунке относительно параметра d11 равна 0,4.

Применим теперь описанный выше метод для поиска верхней границы сле-

дующего интервала устойчивости [0,4, h2). Вычисления приводятся в сокра-

щенном виде: показаны только те их места, где возникают новые оценки ε.

Момент t = 0:

Начальное состояние (текущие потенциалы): U(0) = (0,9; 0; 0,9).

1. Начальное внешнее состояние Y (0) = (1; 0,1).

2. X(0) = (0,4 + ε; 0,3).

3. Силы воздействия:

s1(0) = w12x2(0) = -0,3;

s2(0) = w21x1(0) = 0,8 + 2ε;

s3(0) = w31x1(0) + w32x2(0) = -0,2 - 0,3 - 0,5ε = -0,5 - 0,5ε.

4. Суммарные скорости:

v1(0) = s1(0) + v11en = -0,3 + 0,8 = 0,5,

v2(0) = s2(0) + v02en = 0,8 + 2ε - 0,8 = 2ε,

v3(0) = s3(0) + v13en = -0,5 - 0,5ε + 0,8 = 0,3 - 0,5ε.

5. Остаточные потенциалы:

ΔU1(0) = ∞,

ΔU2(0) = P2 - U2(0) = 0,6,

ΔU3(0) = ∞.

Последнее равенство верно при условии, что v3(0) = 0,3 - 0,5ε ≥ 0, откуда

ε ≤ 0,6 (Шаг М2).

6. Остаточные времена:

τr1(0) = ∞,

τr2(0) = ΔU2(0)/ | v2(0) |= 0,6/2ε,

τr3(0) = ∞.

7. Минимальное остаточное время τmin(0) = τ2(0) = 0,6/2ε.

Соответственно, длина такта [0, 1) τ(0) = 0,6/2ε.

Событие, произошедшее в момент 1, - включение агента N2.

145

8. Потенциалы для момента t = 1:

U (1) = (0,9; 0,6; 0,9).

Таким образом, как и следовало ожидать, при d11 > 0,4 начальное состоя-

ние Y (0) уже не стационарно и сеть генерирует новое поведение. Обозначим

его через B04ε.

Вычисления для тактов 1, 2, 3 ничего не добавляют к оценке ε. На 4-м

такте ε исчезает из значений параметров, потому что выключился его носи-

тель N1. На 5-м такте ε снова появляется. К этому моменту

U1(5) = 0,6,

U2(5) = U2(4) + τ(4)v2(4) = 0,6 - 0,6 · 0,8 = 0,12,

U3(5) = 0 + 0,6 · 0,5 = 0,3.

Вычисления на такте 5 дают следующие результаты.

Момент t = 5:

1. Внешнее состояние Y (5) = (1, 0, 0).

Вычисленное поведение: 101, 111, 110, 010, 000, 100.

2. X(5) = (0,4 + ε; 0).

3. Силы воздействия:

s1(5) = w12 · x2(5) = 0;

s2(5) = w21 · x1(5) = 2 · (0,4 + ε) = 0,8 + 2ε;

s3(5) = w31 · x1(5) + w32 · x2(5) = -0,5(0,4 + ε) = -0,2 - 0,5ε.

4. Суммарные скорости:

v1(5) = s1(5) + v11en = 0,8,

v2(5) = s2(5) + v02en = 0,8 + 2ε - 0,8 = 2ε,

v3(5) = s3(5) + v03en = -0,2 - 0,5ε + 0,5 = 0,3 - 0,5ε.

5. Остаточные потенциалы:

ΔU1(5) = ∞,

ΔU2(5) = P2 - U2(5) = 0,6 - 0,12 = 0,48,

Δ3(5) = 0,6 - 0,3 = 0,3.

6. Остаточные времена:

τr1(5) = ∞,

τr2(5) = ΔU2(5)/ | v2(5) = 0,48/2ε = 0,24/ε,

τr3(5) = 0,3/(0,3 - 0,5ε) = 0,6/(0,6 - ε).

Рассмотрим неравенство

0,6/(0,6 - ε) < 0,24/ε. После преобразований

получаем ε < 0,4(0,6 - ε), откуда ε < 0,1714 и 0,4 + ε < 0,5714. Поэтому

τr3(5) < τr2(5). В результате событием, произошедшим в момент 6, являет-

ся включение нейрона N3, а верхняя граница поведения B04ε до 5-го такта

равна 0,5714.

146

Вычисления до такта 7 ничего не добавляют к оценке ε. К моменту 7

получаем значения потенциалов, совпадающие с их значениями на такте 1:

U (7) = U(1) = (0,9; 0,6; 0,9). Таким образом, на этом такте система входит в

цикл: B04 = 101, (111, 110, 010, 000, 100, 101). Поэтому новых оценок ε уже не

будет, оценка ε < 0,1714 - окончательная, верхняя граница интервала значе-

ний d11, в котором сеть генерирует поведение B04, равна 0,5714.

Вычисления показывают, что при d11 = 0,58 поведение сети действительно

отличается от B04. Протокол B04 для d11 = 0,5 приведен в табл. 4.

6. Заключение

Как уже было отмечено, предложенная модель интерпретируется как био-

логическая нейронная сеть с химическими взаимодействиями [1]. Кроме то-

го, ее можно интерпретировать как социальную сеть с разными типами ин-

формационных обменов. Заметим, что социальные сети с разными типами

активности уже рассматривались в [9, 10]. В нейробиологической интерпре-

тации цветные сигналы - это трансмиттеры, пространство сигналов - это

внеклеточное пространство, потенциал - это мембранный потенциал нейро-

на. В социальной сети цветные сигналы - это специальные каналы связи,

доступные только определенному виду агентов, пространство сигналов - это

общая доска объявлений, на которой каждый агент видит только сообщения

определенного цвета; потенциал вместе с эндогенной скоростью - это харак-

теристика инертности агента, уровня его готовности к переключению.

Предложенный метод структурирования поведения формально пригоден

для любых статических параметров, однако наибольший интерес представ-

ляет структурирование по параметрам dij . Дело в том, что эти параметры

(цветные сигналы) могут изменять пространство сигналов в результате внеш-

них воздействий, тогда как остальные параметры (веса, пороги, эндогенные

скорости) являются внутренними характеристиками агентов, изменение ко-

торых гораздо более затруднено. В частности, метод структурирования пове-

дения нейробиологических сетей может быть использован для планирования

биологических экспериментов.

СПИСОК ЛИТЕРАТУРЫ

1. Кузнецов О.П., Базенков Н.И., Болдышев Б.А. и др. Асинхронная дискретная

модель химических взаимодействий в простых нейронных системах // Искус-

ственный интеллект и принятие решений. 2018. № 2. С. 3-20.

2. Rao A.S., Georgeff M.P. BDI-agents: From Theory to Practice // Proc. First Int.

Conf. Multiagent Syst. (ICMAS’95) (ed. V. Lesser). AAAI Press / The MIT Press.

1995. P. 312-319.

3. Городецкий В.И., Бухвалов О.Л., Скобелев П.О., Майоров И.В. Современное

состояние и перспективы индустриальных применений многоагентных систем //

Управление большими системами. 2017. Вып. 66. С. 93-157.

4. Muller D.E., Bartky W.S. A theory of asynchronous circuits // Int. Sympos. Switch-

ing Theory in Harvard University. 1959. P. 204-243.

147

5. Варшавский В.И., Кишиневский М.А, Мараховский В.Б. и др. Автоматное

управление асинхронными процессами в ЭВМ и дискретных системах. М.: Нау-

ка, 1986.

6. Brzozowski J.A. Topics in asynchronous circuit theory //Recent Advances Formal

Languages Appl. 2006. V. 25. P. 11-42.

7. Кузнецов О.П. Асинхронные сети с многосортными сигналами // ДАН. 2019.

Т. 487. № 1. С. 10-13.

8. Минский М. Вычисления и автоматы. М.: Мир, 1971.

9. Zhilyakova L.Yu., Gubanov D.A. Double-threshold Model of the Activity Spread-

ing in a Social Network. The Case of Two Types of Opposite Activities // Proc.

11th IEEE Int. Conf. Application of Information and Communication Technologies

AICT2017. 2017. V. 2. P. 267-270.

10. Zhilyakova L.Yu. Modeling the Structure of MIMO-Agents and Their Interactions /

Kuznetsov S., Panov A. (eds.) Artificial Intelligence. RCAI 2019. Communications

in Computer and Information Science, vol. 1093. Cham: Springer, 2019. P. 3-16.

Статья представлена к публикации членом редколлегии В.И. Васильевым.

Поступила в редакцию 02.03.2020

После доработки 11.06.20

Принята к публикации 09.07.2020

148